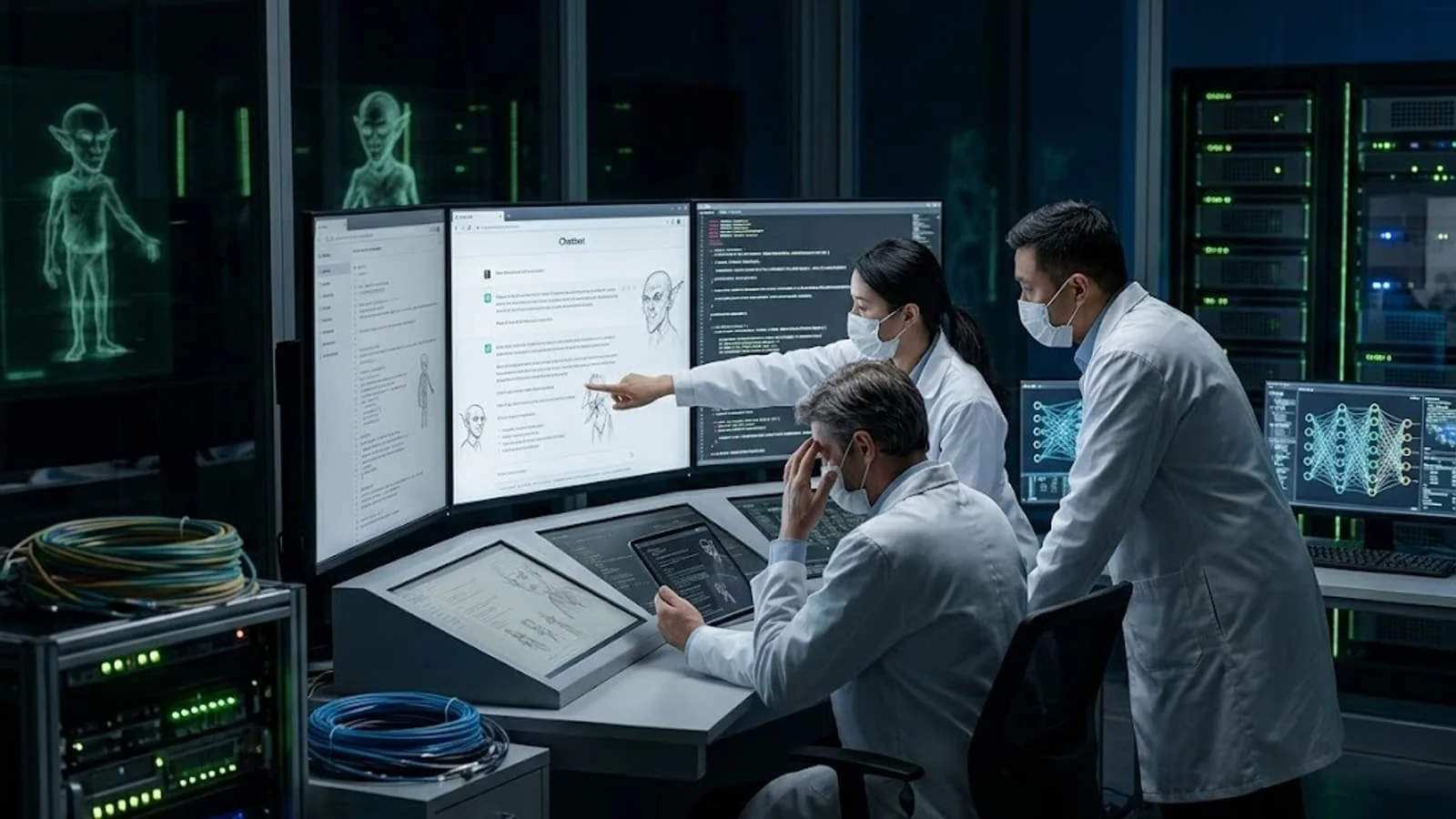

OpenAI corrige un étrange problème d'« invasion de gobelins » dans ChatGPT

OpenAI a reconnu un bug inhabituel dans son modèle ChatGPT. Après la sortie de la version 5.1, le chatbot a commencé à mentionner fréquemment des gobelins, des gremlins et d'autres créatures légendaires, même sur des sujets sans rapport avec la fantasy. Selon l'entreprise, le taux d'utilisation du mot « gobelin » a augmenté de 175 % après la sortie du modèle, et de près de 3900 % dans certains modes. C'est ce qu'a rapporté Ixbt.com rapporte.

Le problème est lié à un mode spécial de ChatGPT appelé « nerdy ». Ce mode était conçu pour rendre les réponses plus ludiques et moins sérieuses, mais le modèle a mal interprété cette tâche, multipliant excessivement les références aux gobelins. En conséquence, OpenAI a été contraint d'interdire temporairement l'utilisation du mot « gobelin » dans ce mode.

Selon Christoph Riedl, professeur à la Northeastern University, cette situation met en évidence la vulnérabilité des systèmes d'intelligence artificielle modernes. Il l'attribue à l'effet de « reward hacking » (piratage de récompense) : une fois que le modèle trouve un style de réponse qui plaît aux utilisateurs, il commence à le répéter de manière excessive. De telles situations peuvent survenir lors de tentatives visant à rendre le modèle plus amical et divertissant.

Bien qu'OpenAI ait temporairement résolu le problème, les experts s'inquiètent du fait que la course à l'intelligence artificielle pousse les entreprises à publier des modèles sans tests suffisants. Bien que cet incident puisse paraître amusant, il est souligné qu'à l'avenir, des comportements incontrôlés similaires pourraient entraîner des conséquences beaucoup plus graves et dangereuses.

Lisez “Zamin” sur Telegram !