Une nouvelle compression peut réduire les coûts de l’IA

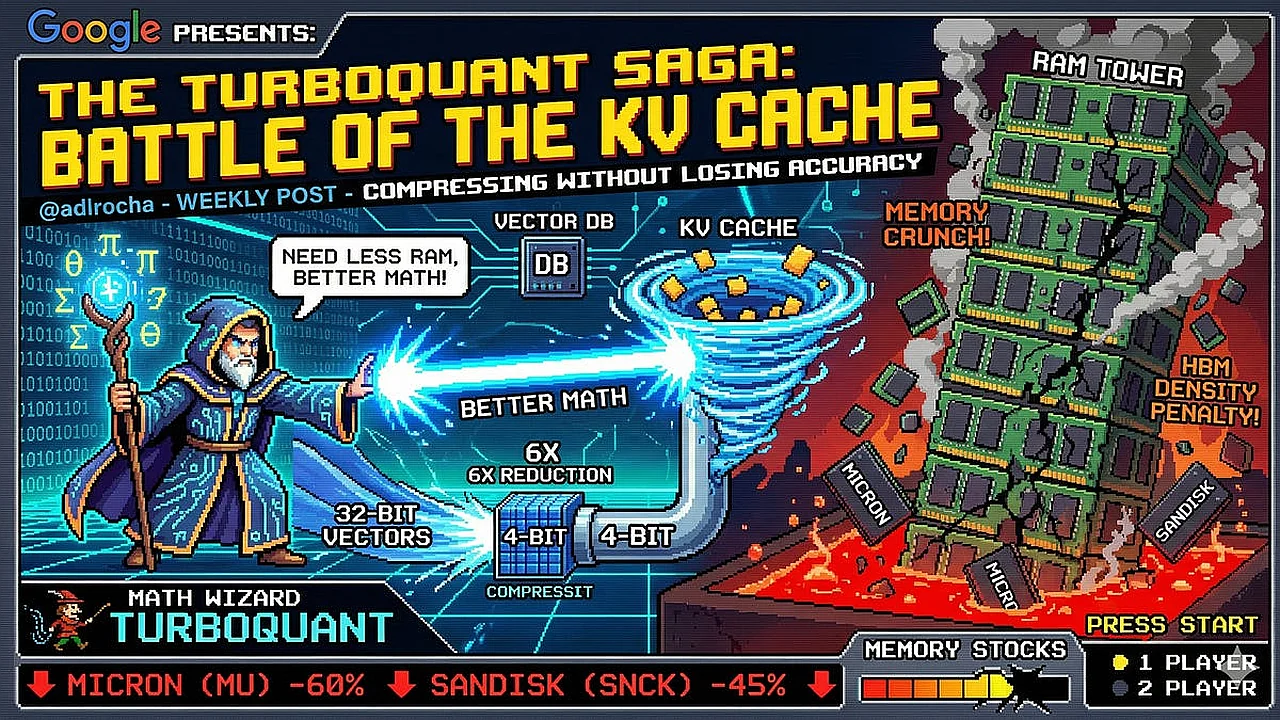

Google a présenté TurboQuant, une méthode visant l’un des plus grands problèmes matériels de l’intelligence artificielle : la mémoire. Au lieu de compter uniquement sur des puces plus grandes et plus coûteuses, l’idée consiste à réduire les données que les grands modèles de langage doivent conserver en mémoire pendant qu’ils génèrent du texte. Cela pourrait compter pour les entreprises qui construisent des systèmes d’IA comme pour les investisseurs qui surveillent le marché des puces mémoire. À ce sujet Adlrocha.substack.com rapporte.

Les grands modèles de langage fonctionnent en prédisant un token à la fois et en se référant constamment aux tokens précédents. Pour le faire efficacement, ils stockent les données de clé et de valeur des étapes antérieures dans ce que l’on appelle un cache KV. Ce cache permet d’éviter de répéter les mêmes calculs, mais il grossit avec chaque nouveau token. Dans les longues conversations, les sessions de codage ou les tâches d’analyse de documents, la demande en mémoire peut devenir énorme.

TurboQuant cible ce cache KV. Selon les documents source, la technique compresse les vecteurs stockés sans entraîner de perte significative de précision du modèle. En termes simples, elle cherche à conserver les avantages d’un grand espace mémoire tout en utilisant moins de mémoire physique sur le GPU. Cela pourrait améliorer l’efficacité de l’inférence et réduire la pression sur l’approvisionnement en mémoire à large bande passante.

Si de telles méthodes se révèlent efficaces à grande échelle, elles pourraient légèrement changer la conversation autour de l’infrastructure de l’IA. La demande de mémoire avancée devrait probablement rester forte, mais une compression plus intelligente pourrait réduire la vitesse à laquelle les besoins en matériel augmentent. Pour le secteur, cela signifie qu’un meilleur logiciel pourrait commencer à résoudre une partie d’un problème que beaucoup s’attendaient à voir corrigé par le seul matériel.

Lisez “Zamin” sur Telegram !