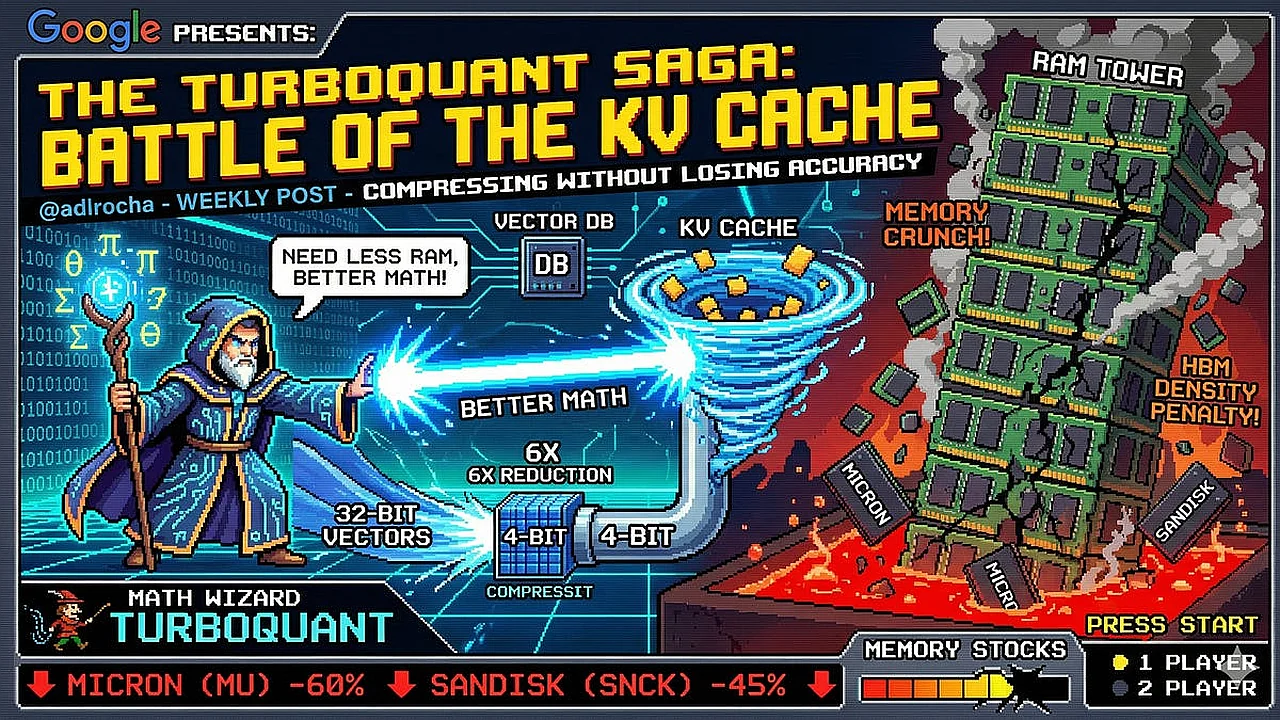

Una nueva compresión puede reducir los costos de IA

Google ha presentado TurboQuant, un método dirigido a uno de los mayores problemas de hardware de la inteligencia artificial: la memoria. En lugar de depender solo de chips más grandes y más caros, la idea es reducir los datos que los grandes modelos de lenguaje deben mantener en memoria mientras generan texto. Eso podría importar tanto para las empresas que construyen sistemas de IA como para los inversores que siguen el mercado de chips de memoria. Al respecto Adlrocha.substack.com informa.

Los grandes modelos de lenguaje funcionan prediciendo un token a la vez y consultando constantemente los tokens anteriores. Para hacerlo de forma eficiente, almacenan los datos de clave y valor de pasos previos en lo que se conoce como caché KV. Esta caché ayuda a evitar repetir los mismos cálculos, pero crece con cada nuevo token. En chats largos, sesiones de programación o tareas de análisis de documentos, la demanda de memoria puede volverse enorme.

TurboQuant apunta a esta caché KV. Según el material de origen, la técnica comprime los vectores almacenados sin causar una pérdida significativa en la precisión del modelo. En términos simples, intenta mantener los beneficios de un gran almacén de memoria mientras usa menos memoria física en la GPU. Eso podría mejorar la eficiencia de la inferencia y reducir la presión sobre el suministro de memoria de alto ancho de banda.

Si estos métodos demuestran ser eficaces a gran escala, podrían cambiar ligeramente la conversación sobre la infraestructura de la IA. Es probable que la demanda de memoria avanzada siga siendo fuerte, pero una compresión más inteligente podría reducir la rapidez con la que crecen las necesidades de hardware. Para la industria, eso significa que un mejor software podría empezar a resolver parte de un problema que muchos esperaban que solo el hardware corrigiera.

¡Lee “Zamin” en Telegram!