Новое сжатие может снизить затраты ИИ

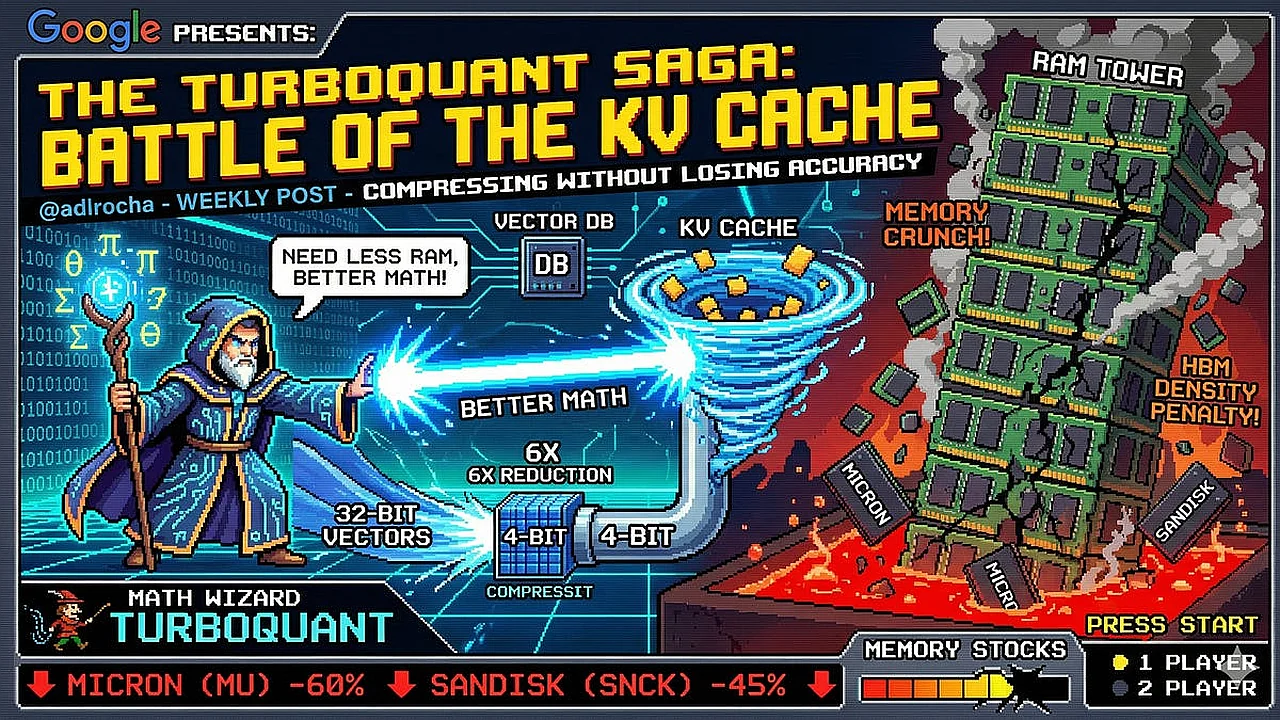

Google представила TurboQuant — метод, нацеленный на одну из крупнейших аппаратных проблем искусственного интеллекта: память. Вместо того чтобы полагаться только на более крупные и дорогие чипы, идея состоит в том, чтобы уменьшить объём данных, которые большие языковые модели должны держать в памяти во время генерации текста. Это может иметь значение как для компаний, создающих системы ИИ, так и для инвесторов, следящих за рынком чипов памяти. Об этом сообщает Adlrocha.substack.com.

Большие языковые модели работают, предсказывая по одному токену за раз и постоянно обращаясь к более ранним токенам. Чтобы делать это эффективно, они хранят данные ключей и значений с предыдущих шагов в так называемом KV-кэше. Этот кэш помогает избегать повторения одних и тех же вычислений, но он растёт с каждым новым токеном. В длинных чатах, сеансах программирования или задачах анализа документов потребность в памяти может становиться огромной.

TurboQuant нацелен именно на этот KV-кэш. Согласно исходным материалам, эта техника сжимает сохранённые векторы, не вызывая заметной потери точности модели. Проще говоря, она стремится сохранить преимущества большого хранилища памяти, используя при этом меньше физической памяти на GPU. Это может повысить эффективность инференса и снизить нагрузку на поставки высокоскоростной памяти.

Если такие методы докажут свою эффективность в крупном масштабе, они могут немного изменить разговор об инфраструктуре ИИ. Спрос на передовую память, вероятно, останется высоким, но более умное сжатие может снизить скорость роста потребностей в оборудовании. Для отрасли это означает, что лучшее программное обеспечение может начать решать часть проблемы, которую многие ожидали устранить только за счёт аппаратного обеспечения.

Читайте «Zamin» в Telegram!