DeepSeek présente son modèle V4 doté de 1 600 milliards de paramètres

Le laboratoire chinois DeepSeek a annoncé ses derniers grands modèles de langage : les versions DeepSeek V4 Flash et V4 Pro. Ces modèles succèdent aux versions V3.2 de l'année dernière et aux célèbres modèles R1, avec des améliorations architecturales significatives. Les deux modèles prennent en charge une fenêtre de contexte allant jusqu'à 1 million de tokens, permettant aux utilisateurs de travailler avec des volumes massifs de documents et de codes. Techcrunch.com en a fait rapport.

Le modèle V4 Pro dispose d'un total de 1,6 billion de paramètres, devenant ainsi le plus grand modèle à poids ouverts (open-weights) au monde. À titre de comparaison, il dépasse largement les modèles Kimi K 2.6 de Moonshot AI (1,1 billion) et DeepSeek V3.2 (671 milliards). Le modèle V4 Flash, plus compact, possède quant à lui 284 milliards de paramètres. Les représentants de l'entreprise affirment que les nouveaux systèmes ont pratiquement comblé l'écart avec les modèles actuels, qu'ils soient ouverts ou fermés, lors des tests de raisonnement logique.

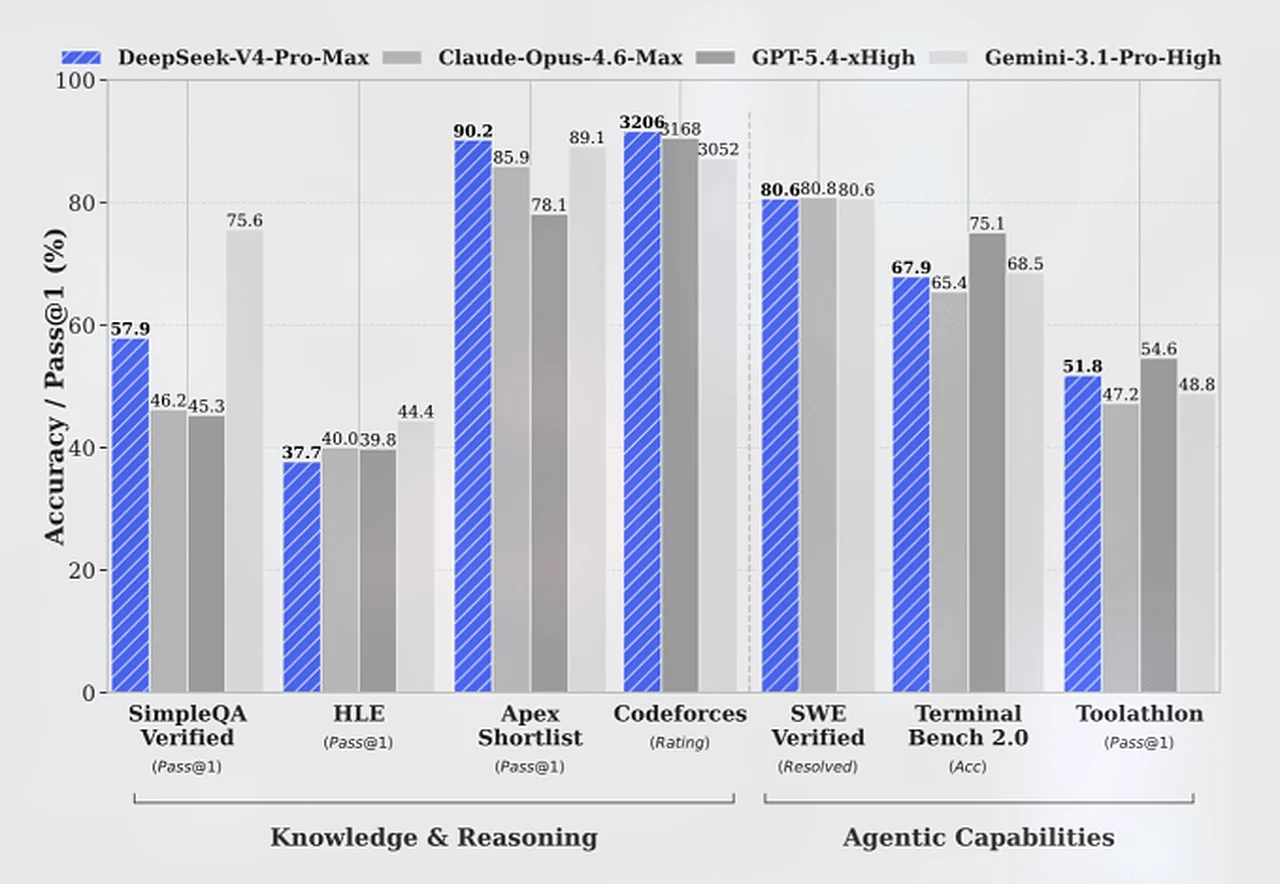

Selon les données de DeepSeek, le modèle V4-Pro-Max surpasse les systèmes GPT-5.2 d'OpenAI et Gemini 3.0 Pro de Google dans les tâches logiques. Lors des compétitions de programmation, les deux nouveaux modèles ont affiché des résultats équivalents à ceux de GPT-5.4. Toutefois, il a été noté que dans les tests évaluant le niveau de connaissances générales, les modèles chinois accusent encore un retard de 3 à 6 mois par rapport aux systèmes américains les plus avancés.

Les nouveaux modèles sont nettement moins chers que leurs concurrents sur le marché. Par exemple, le modèle V4 Flash coûte 0,14 dollar pour 1 million de tokens d'entrée, ce qui est inférieur aux tarifs de GPT-5.4 Nano et Gemini 3.1 Flash. Il convient de souligner que cette présentation intervient alors que les États-Unis lancent des accusations de vol de propriété intellectuelle contre la Chine et que la société DeepSeek est accusée de copier les modèles d'Anthropic et d'OpenAI.

Lisez “Zamin” sur Telegram !