DeepSeek представила модель V4 с 1,6 триллиона параметров

Китайская лаборатория DeepSeek анонсировала свои новейшие большие языковые модели — версии DeepSeek V4 Flash и V4 Pro. Данные модели являются преемниками прошлогодней V3.2 и популярной модели R1, получив значительные архитектурные улучшения. Обе модели поддерживают контекстное окно объемом до 1 миллиона токенов, что позволяет пользователям работать с огромными массивами документов и кодов. Об этом сообщает Techcrunch.com.

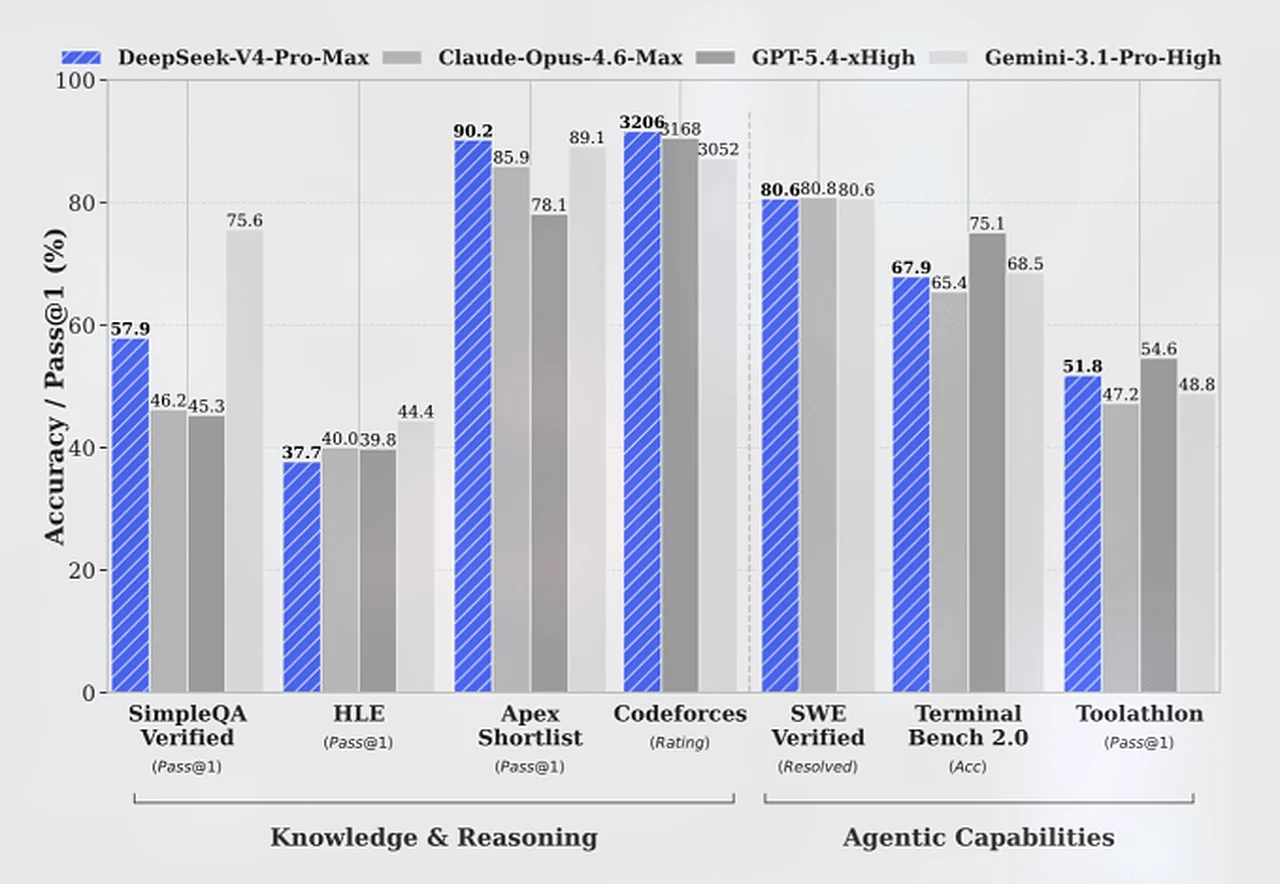

Модель V4 Pro обладает в общей сложности 1,6 триллиона параметров, став на данный момент крупнейшей в мире моделью с открытыми весами. Для сравнения, она значительно превзошла модели Kimi K 2.6 (1,1 триллиона) от компании Moonshot AI и DeepSeek V3.2 (671 миллиард). Меньшая модель V4 Flash имеет 284 миллиарда параметров. Представители компании отметили, что в тестах на логическое мышление новые системы практически сократили разрыв с нынешними ведущими открытыми и закрытыми моделями.

Согласно данным DeepSeek, модель V4-Pro-Max в логических задачах превосходит системы GPT-5.2 от OpenAI и Gemini 3.0 Pro от Google. В соревнованиях по программированию обе новые модели показали результаты, равные GPT-5.4. Однако было отмечено, что в тестах на уровень знаний китайские модели все еще отстают от самых передовых систем США на период от 3 до 6 месяцев.

Новые модели значительно дешевле конкурентов на рынке по стоимости. Например, модель V4 Flash запрашивает 0,14 доллара за 1 миллион входных токенов, что ниже цен на GPT-5.4 Nano и Gemini 3.1 Flash. Стоит подчеркнуть, что данная презентация состоялась на фоне звучащих со стороны США обвинений в адрес Китая в краже интеллектуальной собственности и обвинений компании DeepSeek в копировании моделей Anthropic и OpenAI.

Читайте «Zamin» в Telegram!