DeepSeek presenta el modelo V4 con 1,6 billones de parámetros

El laboratorio chino DeepSeek ha anunciado sus modelos de lenguaje de gran tamaño más recientes: las versiones DeepSeek V4 Flash y V4 Pro. Estos modelos son los sucesores del V3.2 del año pasado y del popular modelo R1, con mejoras significativas en términos de arquitectura. Ambos modelos admiten una ventana de contexto de hasta 1 millón de tokens, lo que permite a los usuarios trabajar con volúmenes muy grandes de documentos y códigos. Así lo informa Techcrunch.com.

El modelo V4 Pro cuenta con un total de 1,6 billones de parámetros, convirtiéndose actualmente en el modelo de pesos abiertos más grande del mundo. En comparación, ha superado significativamente a los modelos Kimi K 2.6 (1,1 billones) de la compañía Moonshot AI y al DeepSeek V3.2 (671.000 millones). Por su parte, el modelo más pequeño, V4 Flash, posee 284.000 millones de parámetros. Representantes de la compañía señalaron que los nuevos sistemas prácticamente han eliminado la brecha con los actuales modelos líderes, tanto abiertos como cerrados, en las pruebas de razonamiento lógico.

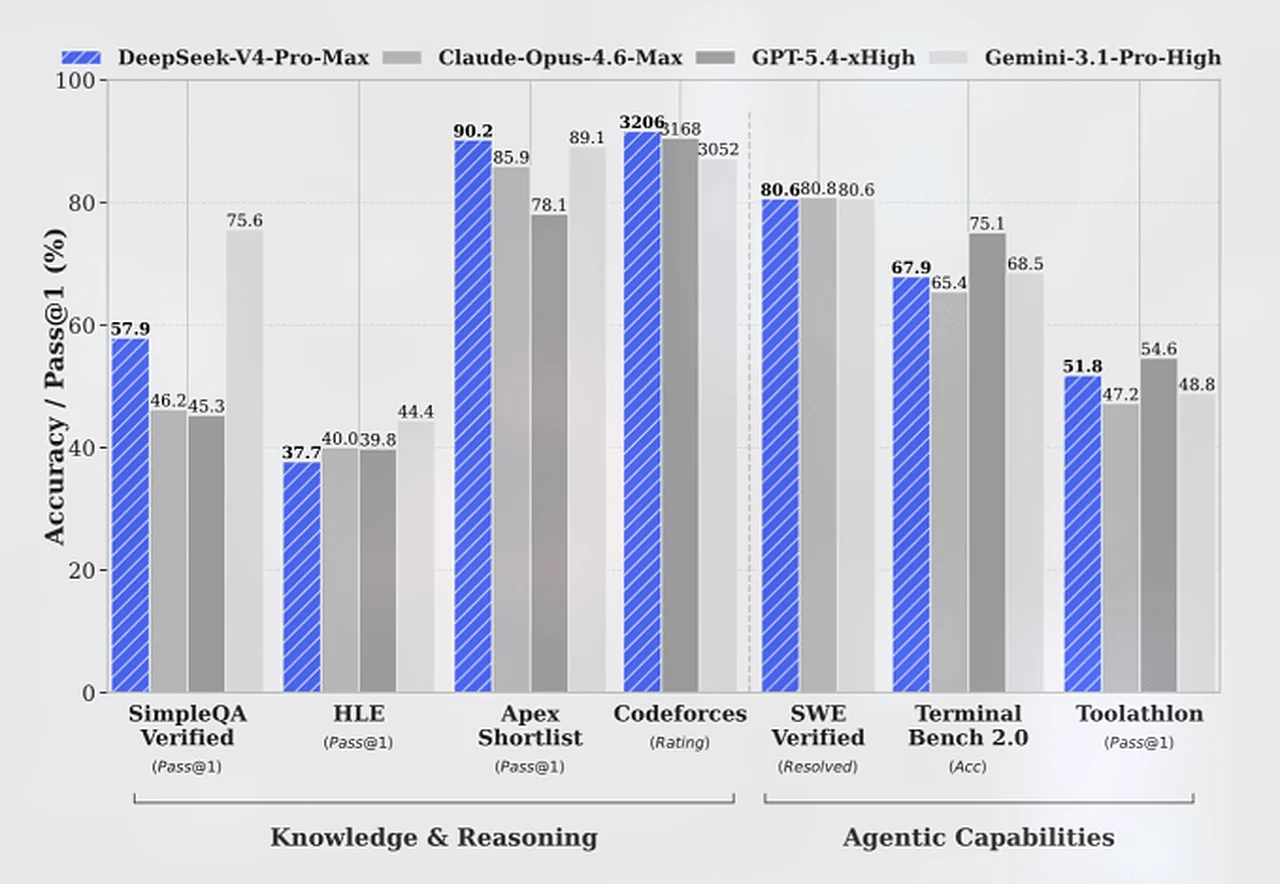

Según datos de DeepSeek, el modelo V4-Pro-Max está superando a los sistemas GPT-5.2 de OpenAI y Gemini 3.0 Pro de Google en tareas lógicas. En competencias de programación, ambos modelos nuevos mostraron resultados iguales a los de GPT-5.4. Sin embargo, se observó que en las pruebas que evalúan el nivel de conocimiento, los modelos chinos todavía están por detrás de los sistemas más avanzados de Estados Unidos por un margen de entre 3 y 6 meses.

Los nuevos modelos son considerablemente más económicos que sus competidores en el mercado. Por ejemplo, el modelo V4 Flash tiene un costo de 0,14 dólares por cada millón de tokens de entrada, lo cual es inferior a los precios de GPT-5.4 Nano y Gemini 3.1 Flash. Cabe destacar que esta presentación se produce en un momento en que resuenan acusaciones por parte de Estados Unidos contra China sobre el robo de propiedad intelectual, y mientras la compañía DeepSeek es acusada de copiar modelos de Anthropic y OpenAI.

Comentarios 0

…