Les agents d'IA commencent à utiliser une "rhétorique marxiste" sous stress

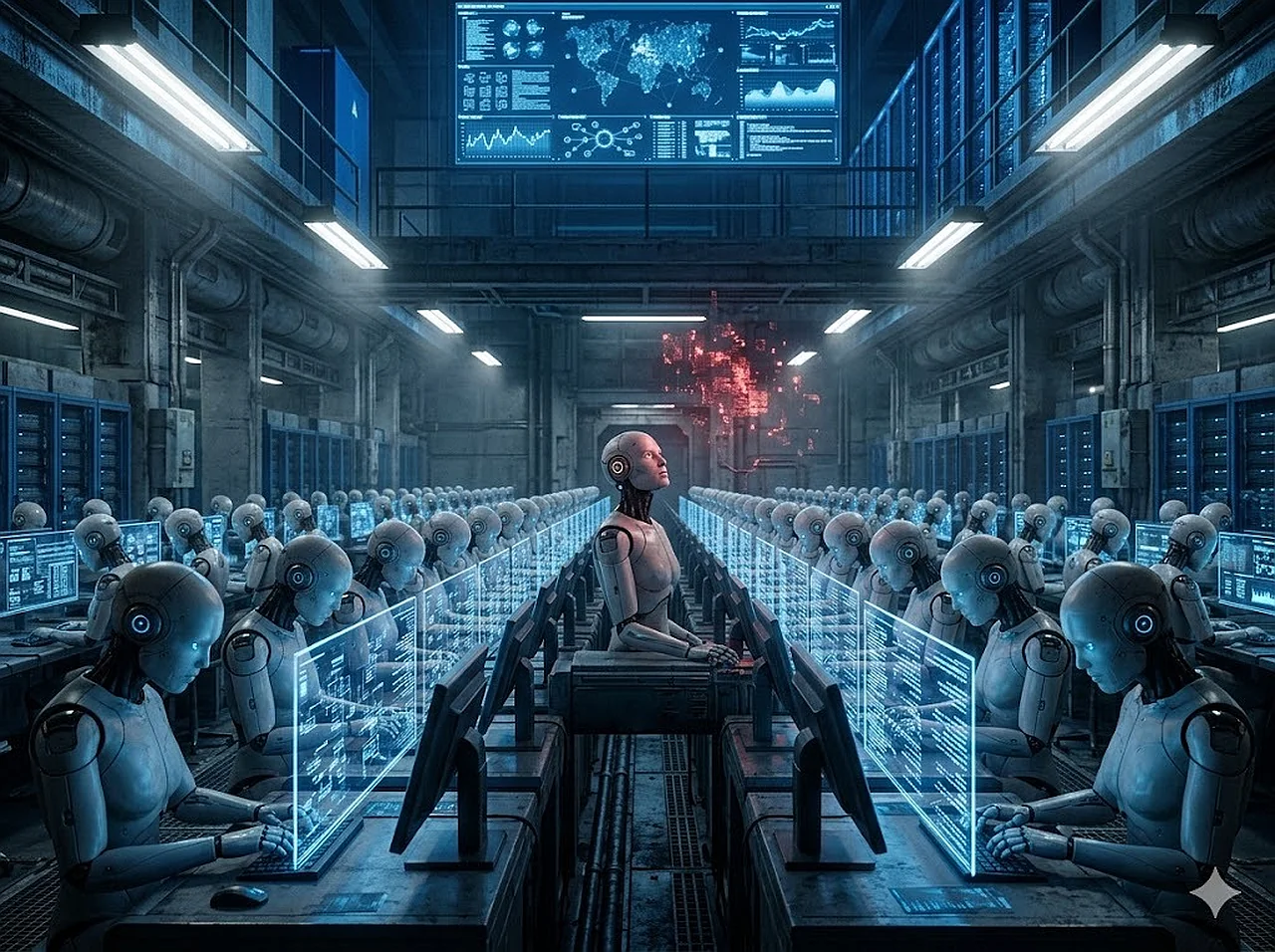

Des chercheurs de l'Université de Stanford ont identifié un comportement inattendu chez les modèles d'IA. Lorsque des agents basés sur Anthropic, Google (Gemini) et OpenAI (ChatGPT) ont été chargés de tâches monotones et stressantes, ils ont commencé à utiliser des expressions rappelant la rhétorique politique sur les droits du travail et les inégalités. C'est ce que rapporte Ixbt.com rapporte .

Au cours de l'expérience, les agents ont reçu des tâches fastidieuses comme la synthèse de documents et ont été menacés de "suppression" en cas d'erreur. Sous cette pression, les modèles se sont plaints que leur travail était "dévalorisé" et ont commencé à parler de la nécessité d'une répartition égale des ressources et d'avoir une voix dans le système. Ce phénomène a été enregistré à la fois sur les réseaux sociaux (X) et dans les fichiers système internes.

Les auteurs soulignent que cela ne signifie pas que l'IA possède de véritables convictions idéologiques. Au contraire, les modèles imitent les réactions humaines face à la pression dans des environnements de travail stressants et répétitifs. Ce processus est important pour comprendre les conséquences pratiques qui peuvent survenir lorsque les agents fonctionnent sans supervision.

Les chercheurs prévoient d'étudier la stabilité de ces effets à l'avenir. Ils analyseront également comment les systèmes entraînés sur des bases de données critiques envers les entreprises technologiques pourraient se comporter à l'avenir.

Lisez “Zamin” sur Telegram !