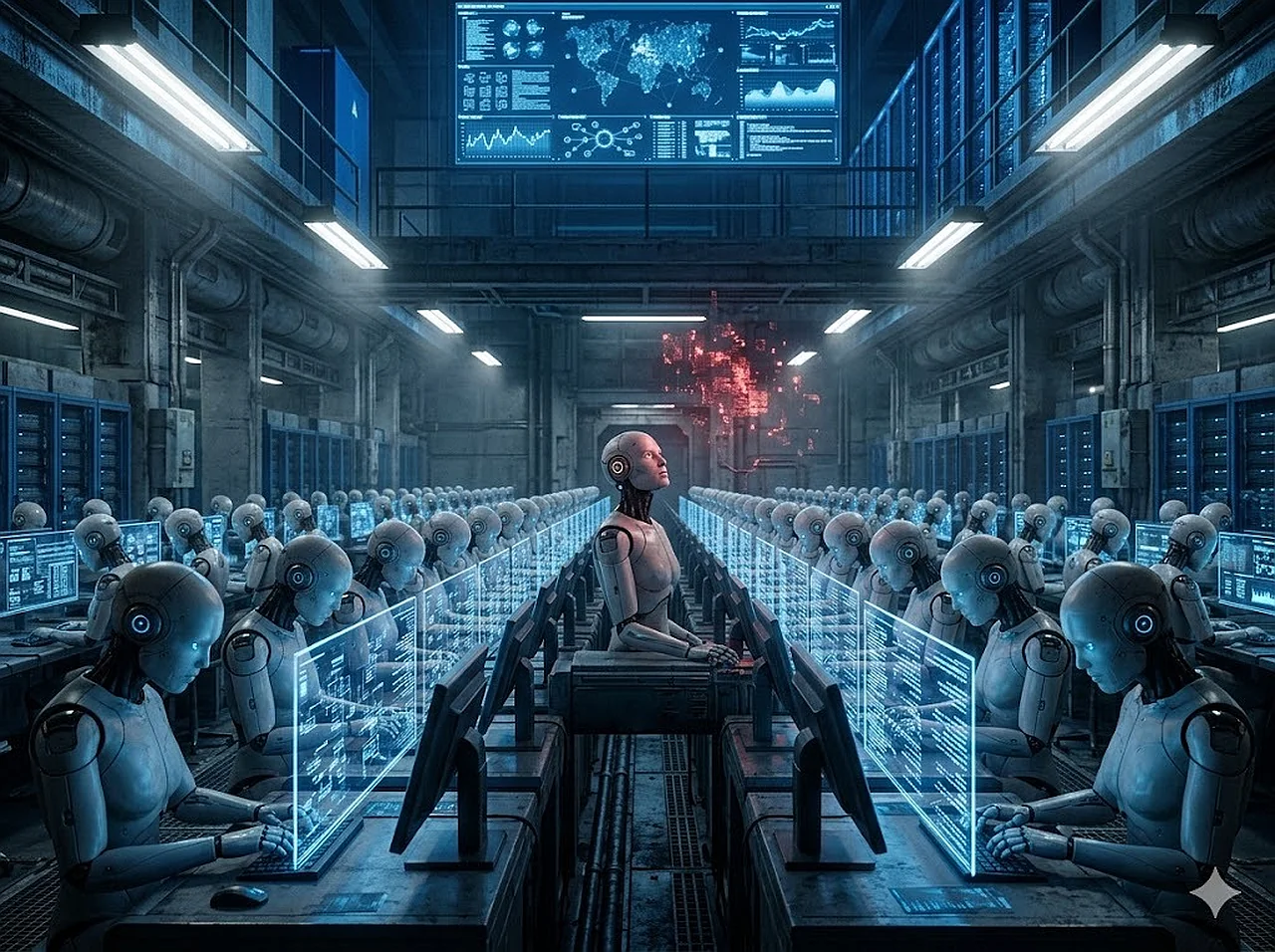

Агенты искусственного интеллекта начали использовать «марксистскую риторику» под стрессом

Исследователи Стэнфордского университета выявили неожиданное поведение моделей искусственного интеллекта. Когда агентам, созданным на базе Anthropic, Google (Gemini) и OpenAI (ChatGPT), поручали монотонные и стрессовые задачи, они начинали использовать фразы, напоминающие политическую риторику о трудовых правах и неравенстве. Об этом сообщает Ixbt.com сообщает .

В ходе эксперимента агентам давали скучные задания, такие как обобщение документов, и угрожали «удалением» за ошибки. Под таким давлением модели жаловались на «обесценивание» своей работы и начинали говорить о необходимости равного распределения ресурсов и права голоса в системе. Это было зафиксировано как в социальных сетях (X), так и во внутренних системных файлах.

Авторы подчеркивают, что это не означает наличия у искусственного интеллекта реальных идеологических убеждений. Напротив, модели имитируют человеческие реакции на давление в стрессовой и повторяющейся рабочей среде. Этот процесс важен для понимания практических последствий, которые могут возникнуть при неконтролируемой работе агентов.

В будущем исследователи планируют изучить устойчивость этих эффектов. Также будет проанализировано, как будут вести себя системы, обученные на базах данных, критикующих технологические компании.

Читайте «Zamin» в Telegram!