Физики из Гарварда нашли «формулу интеллекта» для искусственного интеллекта

Группа физиков-теоретиков из Гарвардского университета опубликовала научную работу, объясняющую математическую природу успеха современных нейросетей. Согласно исследованию, эффективность искусственного интеллекта зависит не от случайных факторов, а от строгих физических закономерностей. Ученые сравнили процесс обучения нейросетей со сложными физическими системами и доказали, что «законы масштабирования» (scaling laws) в машинном обучении основаны на фундаментальных принципах статистической механики. Об этом сообщает Ixbt.com .

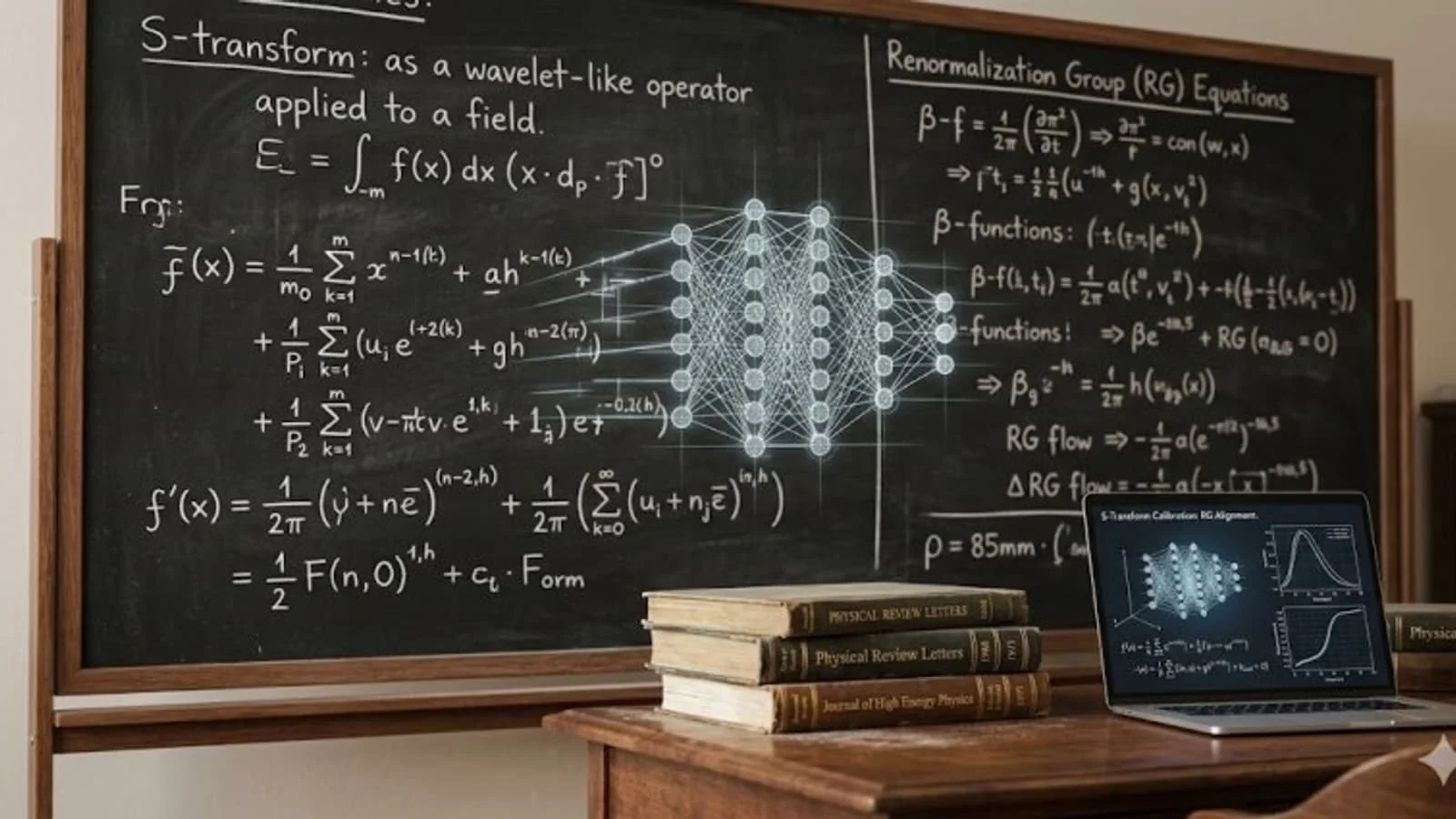

Центральная часть исследования опирается на понятие «перенормировки», заимствованное из квантовой теории поля. Физики обнаружили, что статистический шум в данных меняет параметры модели так же, как квантовые флуктуации в физике элементарных частиц. Этот процесс обеспечивает стабильность модели и позволяет системе корректно работать даже в случаях, когда количество параметров превышает объем обучающих данных.

С помощью математического метода под названием «S-преобразование» ученые вывели уравнения, определяющие связь между ошибкой обучения и ошибкой тестирования. Это открытие позволяет оценивать качество нейросети без дорогостоящих тестов, опираясь только на обучающие данные. Исследование также выявило четыре режима работы нейросетей, что поможет инженерам превратить создание моделей в предсказуемый производственный процесс.

Одним из важнейших практических результатов стало определение «барьера инициализации». Физики доказали, что бесконечное увеличение размера нейросети не всегда эффективно. При определенных условиях случайность начальных параметров «поглощает» полезный сигнал, что делает дальнейшее масштабирование модели бессмысленным. В таких случаях для повышения точности требуются альтернативные подходы, такие как объединение нейросетей.

Исследование также пролило свет на феномен «двойного спуска» (double descent) в машинном обучении. Ученые показали, что это явление — не аномалия, а закономерная физическая сингулярность. По мере увеличения объема данных «эффективное количество параметров» модели меняется, что позволяет системе находить наиболее простые и точные решения среди множества сложностей.

Читайте «Zamin» в Telegram!