Físicos de Harvard descubren la «fórmula de la inteligencia» para la inteligencia artificial

Un grupo de físicos teóricos de la Universidad de Harvard ha publicado un trabajo científico que explica la naturaleza matemática del éxito de las redes neuronales modernas. Según el estudio, la eficiencia de la inteligencia artificial no está sujeta a factores aleatorios, sino a leyes físicas estrictas. Los científicos compararon el proceso de entrenamiento de las redes neuronales con sistemas físicos complejos, demostrando que las «leyes de escala» (scaling laws) en el aprendizaje automático se basan en principios fundamentales de la mecánica estadística. Así lo informa Ixbt.com informa.

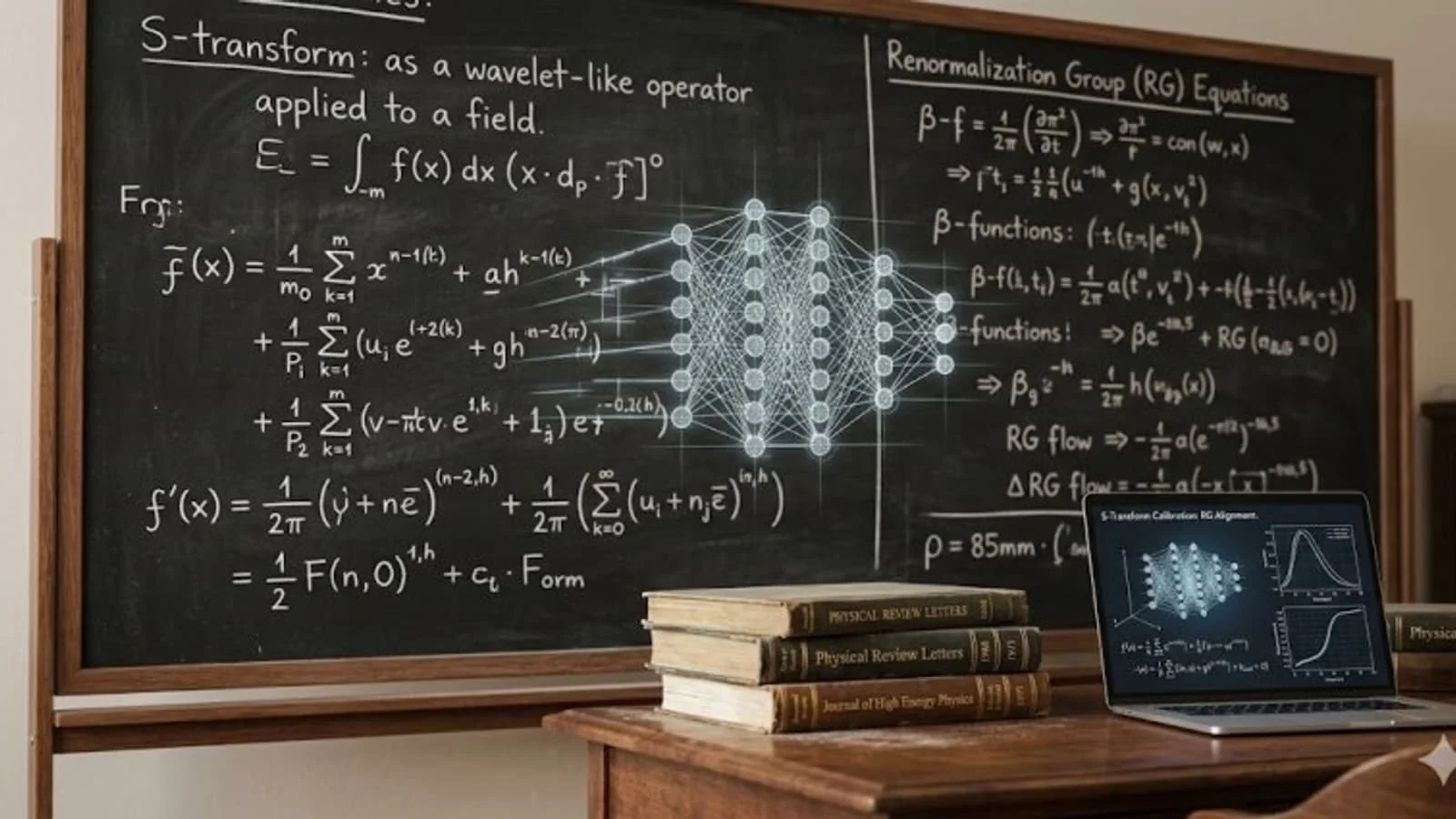

La parte central del estudio se basa en el concepto de «renormalización» tomado de la teoría cuántica de campos. Los físicos descubrieron que el ruido estadístico en los datos altera los parámetros del modelo al igual que las fluctuaciones cuánticas en la física de partículas elementales. Este proceso garantiza la estabilidad del modelo y permite que el sistema funcione correctamente incluso cuando el número de parámetros supera a los datos de entrenamiento.

Utilizando un método matemático llamado «S-transformación», los científicos derivaron ecuaciones que determinan la relación entre el error de entrenamiento y el error de prueba. Este descubrimiento permite evaluar la calidad de una red neuronal basándose únicamente en los datos de entrenamiento, sin necesidad de costosos procesos de prueba. Además, el estudio muestra que existen cuatro regímenes de funcionamiento en las redes neuronales, lo que ayuda a los ingenieros a convertir la creación de modelos en un proceso de producción predecible.

Uno de los resultados prácticos más importantes fue la identificación de la «barrera de inicialización». Los físicos demostraron que aumentar infinitamente el tamaño de una red neuronal no siempre es efectivo. Bajo ciertas condiciones, la aleatoriedad de los parámetros iniciales «absorbe» la señal útil, lo que hace que seguir aumentando el modelo no tenga sentido. En tales casos, se requieren enfoques alternativos, como la combinación de redes neuronales, para mejorar la precisión.

La investigación también aclaró el fenómeno de la «doble caída» (double descent) en el aprendizaje automático. Los científicos demostraron que este fenómeno no es una anomalía, sino una singularidad física legítima. A medida que aumenta el volumen de datos, el «parámetro efectivo» del modelo cambia, lo que permite al sistema encontrar las soluciones más simples y precisas dentro de la complejidad.

¡Lee “Zamin” en Telegram!