Des physiciens de Harvard découvrent la « formule de l'intelligence » pour l'intelligence artificielle

Un groupe de physiciens théoriciens de l'Université Harvard a publié une étude expliquant la nature mathématique du succès des réseaux de neurones modernes. Selon cette recherche, l'efficacité de l'intelligence artificielle ne dépend pas de facteurs aléatoires, mais de lois physiques strictes. Les scientifiques ont comparé le processus d'entraînement des réseaux de neurones à des systèmes physiques complexes, prouvant que les « lois d'échelle » (scaling laws) en apprentissage automatique reposent sur des principes fondamentaux de mécanique statistique. C'est ce que rapporte Ixbt.com rapporte.

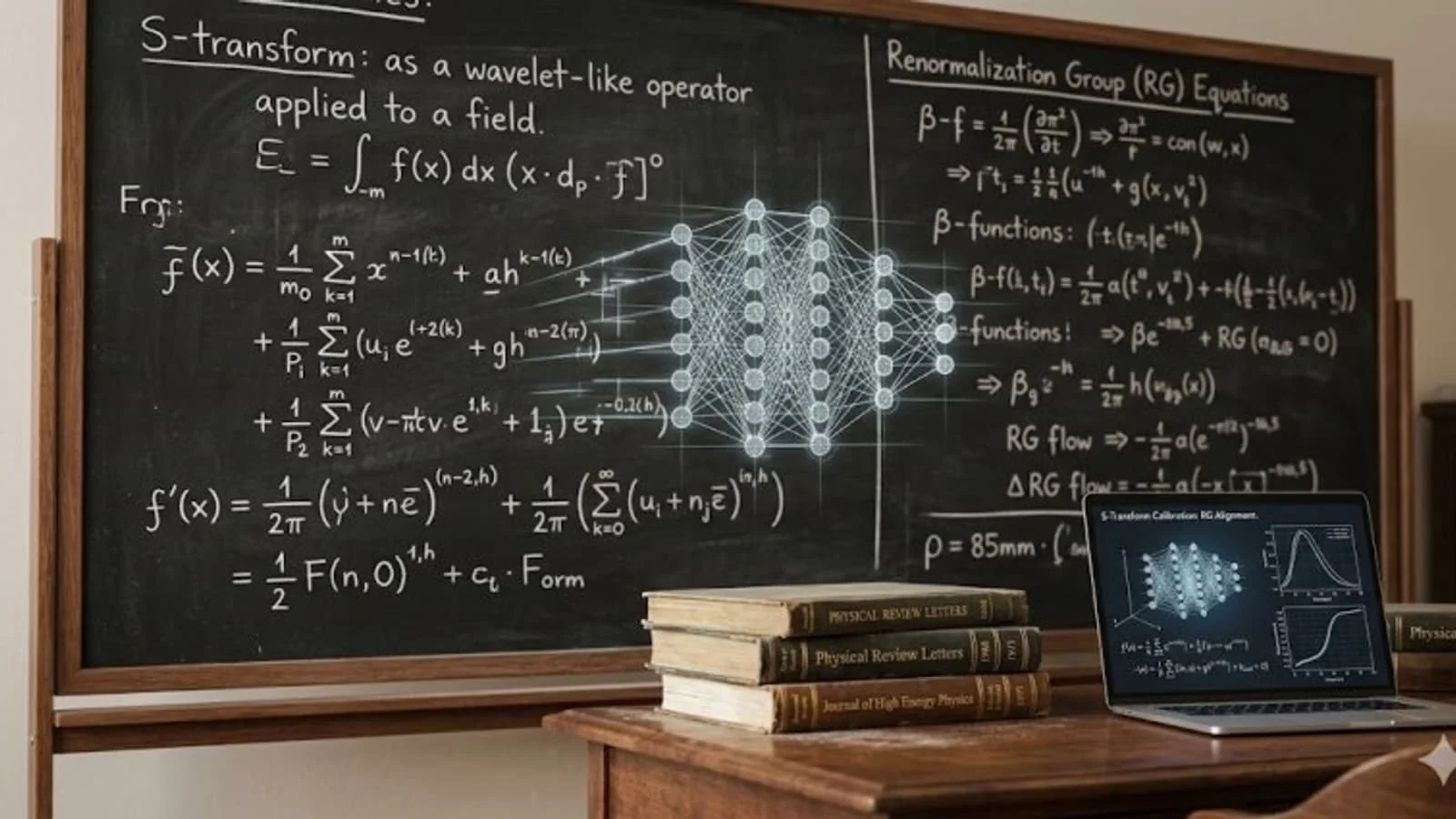

Le cœur de l'étude repose sur le concept de « renormalisation » issu de la théorie quantique des champs. Les physiciens ont découvert que le bruit statistique dans les données modifie les paramètres du modèle tout comme les fluctuations quantiques dans la physique des particules élémentaires. Ce processus assure la stabilité du modèle et permet au système de fonctionner correctement même lorsque le nombre de paramètres dépasse celui des données d'entraînement.

À l'aide d'une méthode mathématique appelée « S-transformation », les scientifiques ont dérivé des équations déterminant la relation entre l'erreur d'entraînement et l'erreur de test. Cette découverte permet d'évaluer la qualité d'un réseau de neurones en se basant uniquement sur les données d'entraînement, sans processus de test coûteux. L'étude identifie également quatre régimes de fonctionnement des réseaux de neurones, aidant les ingénieurs à transformer la création de modèles en un processus de production prévisible.

L'un des résultats pratiques les plus importants a été l'identification de la « barrière d'initialisation ». Les physiciens ont prouvé qu'augmenter indéfiniment la taille d'un réseau de neurones n'est pas toujours efficace. Dans certaines conditions, le caractère aléatoire des paramètres initiaux « absorbe » le signal utile, rendant inutile toute mise à l'échelle supplémentaire du modèle. Dans de tels cas, des approches alternatives, comme la combinaison de réseaux de neurones, sont nécessaires pour améliorer la précision.

La recherche a également clarifié le phénomène de « double descente » (double descent) en apprentissage automatique. Les scientifiques ont montré qu'il ne s'agit pas d'une anomalie, mais d'une singularité physique légitime. À mesure que le volume de données augmente, le « paramètre effectif » du modèle change, permettant au système de trouver les solutions les plus simples et les plus précises au sein de la complexité.

Lisez “Zamin” sur Telegram !