Harvard-Physiker entdecken die „Intelligenzformel“ für künstliche Intelligenz

Eine Gruppe theoretischer Physiker der Harvard University hat eine wissenschaftliche Arbeit veröffentlicht, die die mathematische Natur des Erfolgs moderner neuronaler Netze erklärt. Der Studie zufolge unterliegt die Effizienz künstlicher Intelligenz nicht zufälligen Faktoren, sondern strengen physikalischen Gesetzen. Die Wissenschaftler verglichen den Trainingsprozess neuronaler Netze mit komplexen physikalischen Systemen und bewiesen, dass die „Skalierungsgesetze“ (scaling laws) im maschinellen Lernen auf fundamentalen Prinzipien der statistischen Mechanik beruhen. Dies berichtet Ixbt.com berichtet.

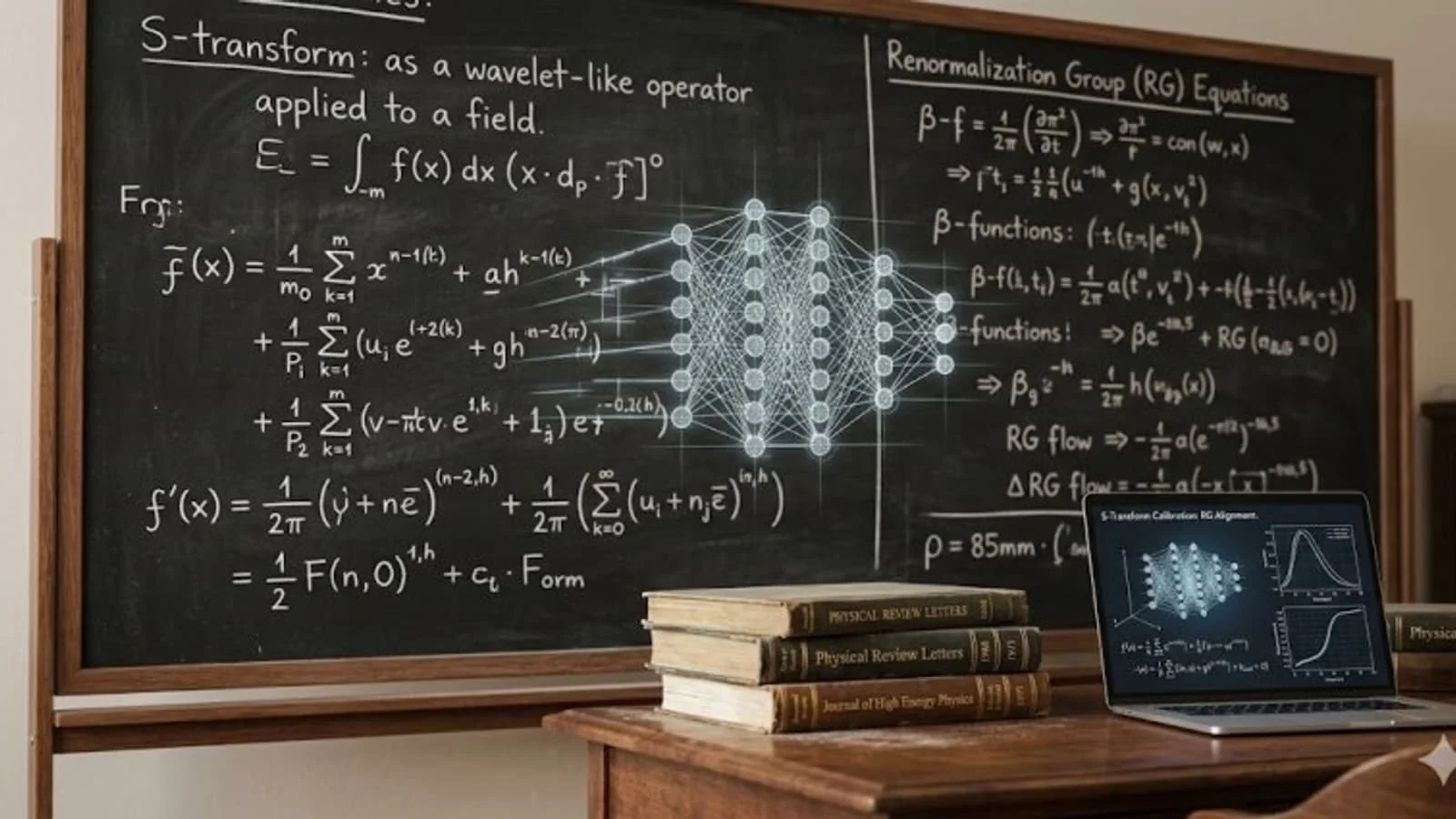

Der Kern der Studie stützt sich auf das Konzept der „Renormierung“ aus der Quantenfeldtheorie. Die Physiker stellten fest, dass statistisches Rauschen in den Daten die Modellparameter ähnlich wie Quantenfluktuationen in der Elementarteilchenphysik verändert. Dieser Prozess gewährleistet die Stabilität des Modells und ermöglicht es dem System, auch dann korrekt zu funktionieren, wenn die Anzahl der Parameter die Trainingsdaten übersteigt.

Mithilfe einer mathematischen Methode namens „S-Transformation“ leiteten die Wissenschaftler Gleichungen ab, die den Zusammenhang zwischen Trainingsfehler und Testfehler bestimmen. Diese Entdeckung ermöglicht es, die Qualität eines neuronalen Netzes allein auf Basis der Trainingsdaten zu bewerten, ohne aufwendige Testprozesse. Zudem zeigt die Studie, dass es vier verschiedene Betriebsmodi für neuronale Netze gibt, was Ingenieuren hilft, die Modellerstellung in einen vorhersagbaren Produktionsprozess zu verwandeln.

Eines der wichtigsten praktischen Ergebnisse war die Identifizierung der „Initialisierungsbarriere“. Die Physiker bewiesen, dass eine unendliche Vergrößerung neuronaler Netze nicht immer effektiv ist. Unter bestimmten Bedingungen „verschluckt“ die Zufälligkeit der Anfangsparameter das nützliche Signal, was eine weitere Skalierung des Modells sinnlos macht. In solchen Fällen sind alternative Ansätze wie das Zusammenführen neuronaler Netze erforderlich, um die Genauigkeit zu erhöhen.

Die Forschung klärte auch das Phänomen des „Double Descent“ (doppelter Abstieg) beim maschinellen Lernen. Die Wissenschaftler zeigten, dass es sich hierbei nicht um eine Anomalie, sondern um eine legitime physikalische Singularität handelt. Mit zunehmender Datenmenge ändert sich der „effektive Parameter“ des Modells, was es dem System ermöglicht, inmitten der Komplexität die einfachsten und präzisesten Lösungen zu finden.

Lesen Sie „Zamin“ auf Telegram!