Harvard fizikçileri yapay zekanın «zeka formülünü» buldu

Harvard Üniversitesi'nden bir grup teorik fizikçi, modern sinir ağlarının başarısının matematiksel doğasını açıklayan bir bilimsel çalışma yayınladı. Araştırmaya göre, yapay zekanın verimliliği rastgele faktörlere değil, katı fiziksel yasalara dayanıyor. Bilim insanları, sinir ağlarının eğitim sürecini karmaşık fiziksel sistemlerle karşılaştırarak, makine öğrenimindeki «ölçeklendirme yasalarının» (scaling laws) temel istatistiksel mekanik prensiplerine dayandığını kanıtladılar. Bu haberi Ixbt.com veriyor.

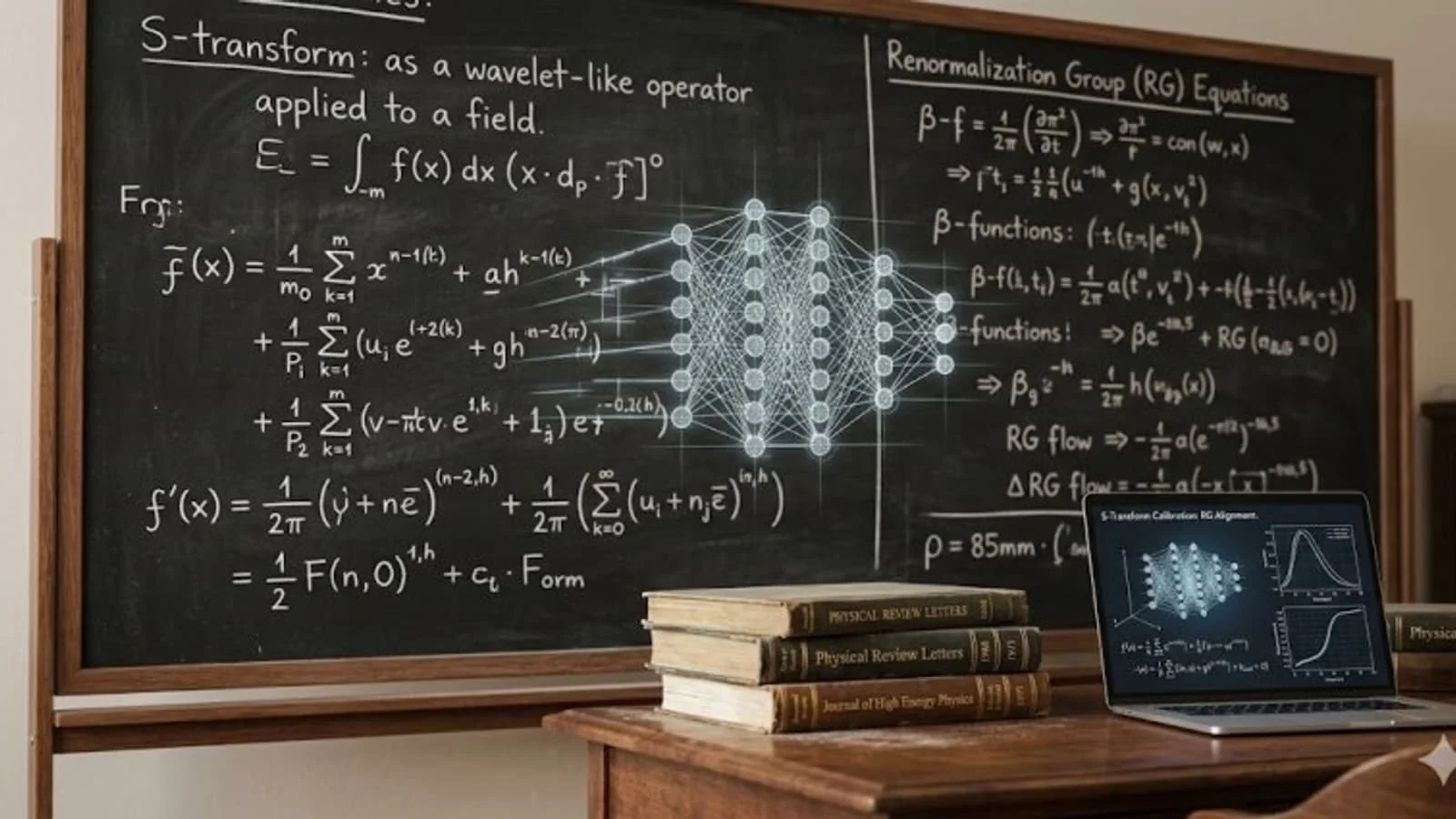

Araştırmanın merkezinde, kuantum alan teorisinden alınan «yeniden normalleştirme» (renormalization) kavramı yer alıyor. Fizikçiler, verilerdeki istatistiksel gürültünün, model parametrelerini tıpkı temel parçacık fiziğindeki kuantum dalgalanmaları gibi değiştirdiğini keşfettiler. Bu süreç, modelin kararlılığını sağlar ve parametre sayısı eğitim verilerinden fazla olduğunda bile sistemin doğru çalışmasına olanak tanır.

Bilim insanları, «S-dönüşümü» adı verilen matematiksel bir yöntem kullanarak eğitim hatası ile test hatası arasındaki ilişkiyi belirleyen denklemler türettiler. Bu keşif, pahalı test süreçleri olmadan sadece eğitim verilerine dayanarak bir sinir ağının kalitesini önceden tahmin etmeyi mümkün kılıyor. Ayrıca araştırma, sinir ağlarının dört farklı çalışma modu olduğunu göstererek mühendislerin model oluşturma sürecini öngörülebilir bir üretim sürecine dönüştürmelerine yardımcı oluyor.

En önemli pratik sonuçlardan biri «başlatma engeli»nin (initialization barrier) tanımlanması oldu. Fizikçiler, bir sinir ağının boyutunu sonsuza kadar artırmanın her zaman verimli olmadığını kanıtladılar. Belirli koşullar altında, başlangıç parametrelerinin rastgeleliği yararlı sinyali «yutar», bu da modelin daha fazla büyütülmesini anlamsız kılar. Bu gibi durumlarda doğruluğu artırmak için sinir ağlarını birleştirmek gibi alternatif yaklaşımlar gerekir.

Araştırma, makine öğrenimindeki «çifte düşüş» (double descent) fenomenine de açıklık getirdi. Bilim insanları, bu olgunun bir anomali değil, yasal bir fiziksel tekillik olduğunu gösterdiler. Veri hacmi arttıkça modelin «etkili parametresi» değişir ve bu da sistemin karmaşıklıklar içindeki en basit ve doğru çözümleri bulmasını sağlar.

“Zamin”i Telegram'da okuyun!