NVIDIA uzoq kontekstli sun’iy intellekt uchun yangi GPU taqdim etdi

NVIDIA uzoq kontekstli inferens — ya’ni katta hajmdagi ma’lumotni uzluksiz qayta ishlash imkoniga ega yangi grafik protsessorini taqdim etdi, deb TechCrunch xabar berdi. Yangi chip GB200 deb nomlanib, katta til modellari (LLM) va generativ sun’iy intellekt uchun mo‘ljallangan.

GB200 chipi 1 million tokengacha kontekstni qo‘llab-quvvatlashi mumkin. Bu esa sun’iy intellekt modellariga kengroq muloqot doirasida mantiqiy javoblar berish va ko‘p sahifali matnlar bilan ishlash imkonini beradi. Bunday imkoniyat ayniqsa kod, hujjat yoki katta hajmdagi matnlar bilan ishlashda muhim hisoblanadi.

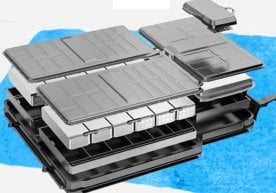

NVIDIA ushbu chipni “GH200 Grace Hopper Superchip” platformasi asosida ishlab chiqqan. Ushbu arxitektura orqali katta LLM modellarini samarali ishlatish, tezkor inferens va energiyani tejash mumkin. GB200 asosidagi serverlar 2026 yilda bozorga chiqishi kutilmoqda.

“Zamin”ni Telegramʻda oʻqing!